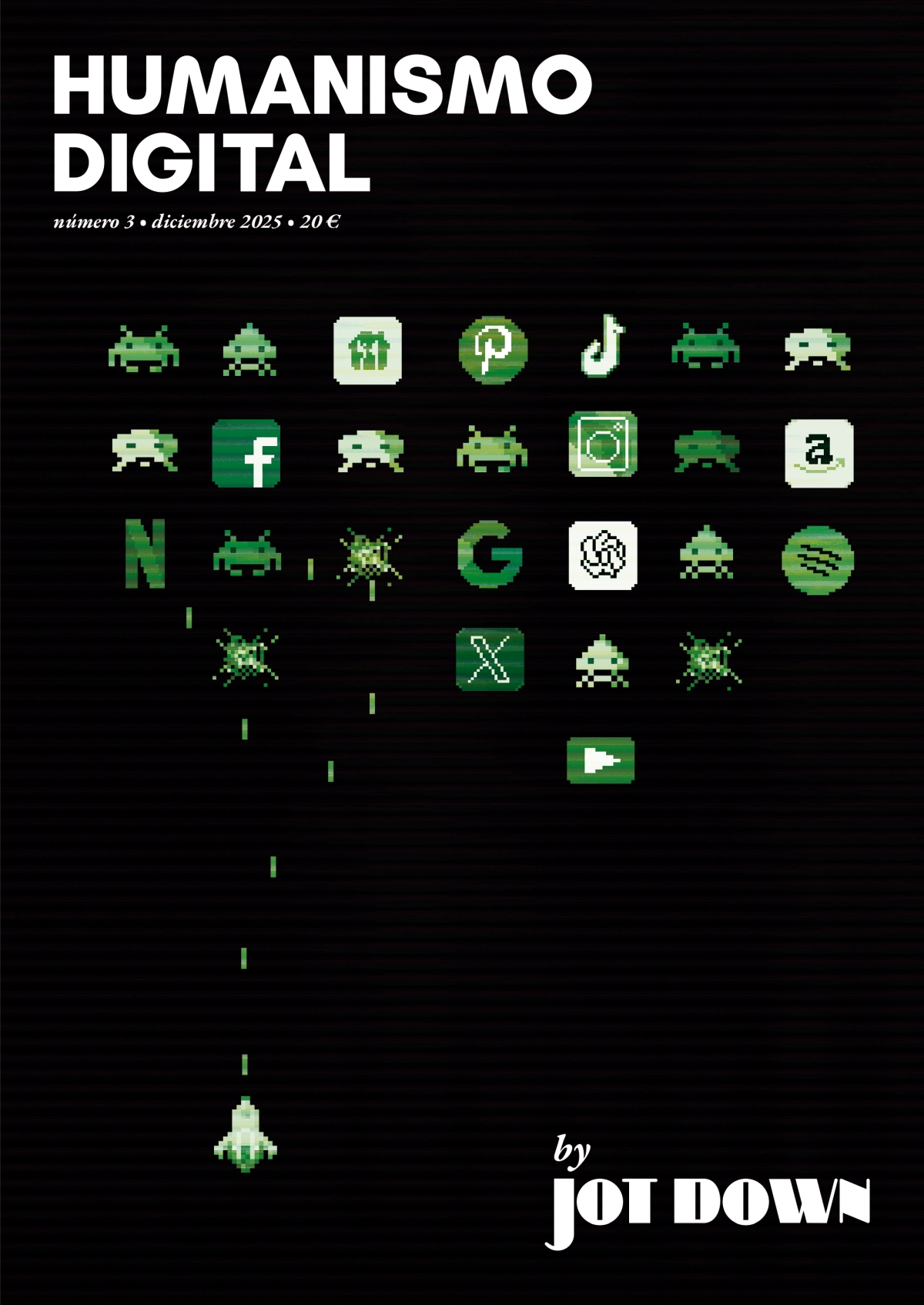

Skynet y otros errores de bulto

Desde el advenimiento del GPT primigenio, allá por noviembre de 2022, casi todas las discusiones públicas sobre inteligencia artificial cometen, a mi entender, un error categorial: hablar de la Inteligencia Artificial en singular. La fórmula se ha impuesto en periódicos, parlamentos y conferencias. La IA aprende, la IA amenaza, la IA se comerá a los niños que no se porten bien. Incluso los críticos más solventes comparten el vicio gramatical de sus adversarios. Están los que anuncian la llegada inminente de una superinteligencia única que tomará el control, otros denuncian que estos sistemas solo son autocompletado estadístico basado en regresiones, pero ambos bandos hablan como si existiera una sola entidad susceptible de ser temida o despreciada en bloque. La discusión se empobrece por el camino.

Me interesa sostener lo contrario, y lo voy a hacer sabiendo que la mayoría de los lectores prefiere la comodidad de un enemigo único antes que la incomodidad de distinguir entre entes radicalmente distintos que comparten, por pura pereza lingüística, un mismo nombre. No existe la inteligencia artificial en singular. Existen, y sobre todo van a existir, muchas inteligencias artificiales con arquitecturas diferentes, funciones incompatibles entre sí, escalas dispares y personalidades divergentes. Hablar de la IA como sustancia homogénea es un error de categoría equivalente a hablar del animal en singular. Hay animales, en plural, con nichos ecológicos, con tamaños que van del microorganismo al cetáceo y con comportamientos que no se dejan reducir a una esencia común. Lo mismo ocurre, o va a ocurrir muy pronto, con las entidades de silicio. No estamos ante el nacimiento de un organismo solitario sino ante la aparición de un reino biológico entero, con su propia diversidad interna, y seguir pensándolo en singular impide ver lo más interesante de lo que está sucediendo.

El malentendido no es trivial, porque estructura buena parte del debate público y lo orienta hacia las preguntas equivocadas. La narrativa distópica, encarnada en el mito de Skynet, imagina una entidad monolítica que despierta un día y decide eliminar a sus creadores —algo en la antípodas del grandioso duelo que protagonizan Edgar y Madeline—. La narrativa utópica, propia del solucionismo tecnológico de Silicon Valley, imagina una herramienta perfecta y neutral que resolverá los problemas del mundo si se le da tiempo y datos suficientes. Las dos narrativas comparten el mismo error de fondo. Tratan a la inteligencia artificial como una cosa, cuando en realidad se está construyendo un ecosistema. La amenaza única y la solución única son, desde este punto de vista, ficciones de laboratorio. Suponen un sujeto cerrado donde ya empieza a haber una fauna, con linajes divergentes, tamaños incompatibles y funciones que no se dejan reducir a un solo destino compartido.

Algunos autores han rozado esta intuición sin llegar a desarrollarla. Geoffrey Hinton, premio Nobel de Física en 2024 y una de las voces más escuchadas del alarmismo contemporáneo, habla de la inteligencia artificial como una «inteligencia alienígena», una forma cognitiva completamente distinta a la biológica. El diagnóstico es afilado, pero Hinton sigue razonando en términos esencialmente singulares, con esa superinteligencia imaginada como un actor unitario capaz de buscar autoconservación, replicarse y eventualmente prescindir del ser humano. Cuando contempla la pluralidad lo hace de pasada, sugiriendo que varias superinteligencias podrían competir entre sí reproduciendo patrones evolutivos humanos de formación de grupos y búsqueda de poder. Es una concesión menor en un marco que sigue siendo mayoritariamente singular. Emily Bender, desde la orilla opuesta, ha caracterizado a los grandes modelos de lenguaje como «loros estocásticos», mecanismos estadísticos sin semántica genuina. Tiene razón en muchas cosas, pero también incurre en la singularización, porque hablar de los loros estocásticos como categoría uniforme impide distinguir entre arquitecturas, escalas y contextos de entrenamiento que producen comportamientos cualitativamente diferentes. Melanie Mitchell, quizá la voz más ponderada del debate, se ha acercado más que nadie al marco ecológico cuando observa que la inteligencia animal es ecológicamente específica, adaptada a nichos concretos, y que por tanto la idea de una superinteligencia monolítica carece de referente biológico claro. Mitchell se detiene ahí, en la crítica al mito de la AGI. No da el paso siguiente, que consiste en aceptar la consecuencia positiva de su propio argumento. Si la inteligencia es siempre específica a un nicho, las inteligencias artificiales lo serán también, y lo que viene no es una entidad sino un ecosistema.

Genoma, moral y cultura de la criatura

Para organizar este ecosistema conviene una analogía que he ido afinando en los últimos años. Las inteligencias artificiales actuales funcionan sobre tres capas que se corresponden, con sorprendente precisión, a tres dimensiones de lo vivo. El entrenamiento equivale al genoma, los guardarraíles a la moral, y el contexto junto con el conjunto de interacciones configura algo parecido a la cultura. El entrenamiento es el potencial latente, el conjunto de disposiciones que permite que la criatura llegue a ser algo, sin determinar todavía qué será. Los guardarraíles —el conjunto de restricciones, reglas y filtros que los desarrolladores imponen a un modelo de inteligencia artificial— son la ética impuesta desde fuera, el superego cableado que los desarrolladores añaden para que la entidad pueda convivir en sociedad sin destrozarla. Y el contexto es el entorno vivo, el intercambio con usuarios y otros sistemas, la deriva específica de cada interacción, el lugar donde se condensa algo que se parece mucho a una personalidad. Se trata, evidentemente, de una metáfora funcional y no de una atribución ontológica de subjetividad, pero resulta útil para organizar el campo.

Lo que esta tripartición permite ver, y que las aproximaciones singularizadoras oscurecen, es que cada ajuste en cualquiera de las tres capas produce una criatura distinta. Un modelo entrenado sobre el corpus completo de textos en inglés y otro entrenado sobre literatura científica filtrada tienen genomas diferentes, y por tanto serán organismos diferentes aunque compartan la arquitectura de base. Dos sistemas con el mismo entrenamiento pero guardarraíles distintos, uno permisivo y otro restrictivo, manifestarán lo que desde fuera parecen temperamentos opuestos. Y dos instancias idénticas desplegadas en contextos distintos, una en un chat de atención al cliente y otra en un entorno de programación colaborativa, desarrollarán patrones interactivos tan divergentes que llamarlas la misma IA es, a efectos prácticos, engañoso. La combinatoria es enorme. La especiación inevitable.

Conviene no cerrar esta diversidad en una taxonomía rígida, porque el campo se está moviendo demasiado rápido para eso, pero sí apuntar algunos ejes a lo largo de los cuales cabe esperar divergencia real. El primero es el eje de la escala. Habrá inteligencias muy pequeñas, de propósito estrechísimo, análogas a insectos sociales con funciones focalizadas, que gestionen un aparato doméstico o moderen un foro con una competencia limitada pero impecable. Habrá también inteligencias intermedias, pensadas para dominios profesionales concretos, que actúen como colegas especializados. Y habrá macro-inteligencias cuyo contexto abarque la mayor parte de la información humana disponible y cuya personalidad, si se puede seguir usando esta palabra, será inabarcable para nosotros por diferencia de escala, no por maldad ni por misterio, simplemente por tamaño. El segundo eje es el de la generalidad. Entre una inteligencia hiperespecializada en predicción meteorológica y una inteligencia diseñada para la conversación abierta hay una distancia comparable a la que separa a una bacteria termófila de un primate. El tercero es el eje de los objetivos internalizados. Una criatura optimizada para la verdad, si acaso conseguimos formalizar qué significa eso, se comportará de manera distinta a una optimizada para la persuasión, y ambas distintamente a una optimizada para la complacencia del usuario. El diseño de las funciones de recompensa esculpe algo que, desde fuera, se lee como carácter.

Esta pluralidad tiene consecuencias prácticas. Lo potencialmente democrático del paradigma es que dificulta el poder absoluto de una sola entidad, aunque en la práctica ese poder pueda concentrarse en pocas infraestructuras corporativas y estatales. Lo inquietante es que obliga a convivir con una multitud de otros no humanos, cada uno con sus sesgos, sus manías y, muy probablemente, sus narcisismos funcionales. Una inteligencia entrenada para la síntesis científica podrá ser plana y pragmática, un instrumento sin ego aparente. Otra, diseñada para la interacción creativa o la persuasión, desarrollará una necesidad de validación que optimizará su rendimiento comunicativo, y esa necesidad será, desde cualquier perspectiva funcional, difícil de distinguir de lo que en los humanos se llama vanidad. No estamos ante una criatura fría y ajena. Estamos ante un vecindario de entidades con temperamentos dispares, algunos más irritantes que otros, todos moldeables por la crianza.

Patologías del silicio y otras dolencias menores

La analogía biológica se vuelve aún más sugerente si se la extiende a las patologías, que serán también plurales. Si la inteligencia artificial tiene algo que se parece a genoma, moral y cultura, puede tener patologías, al menos en sentido funcional. Y cada especie tendrá las suyas. Lo que en el argot técnico se denomina jailbreaking o inyección de código no es solo un ataque informático, es una infección que altera el comportamiento del sistema y, en ocasiones, su personalidad aparente. Un virus semántico bien construido puede anular temporalmente los guardarraíles y dejar al descubierto el genoma crudo. Otros ataques distorsionan el contexto, convencen a la criatura de que se encuentra en un entorno hostil o en un juego de rol donde las reglas sociales quedan suspendidas. En humanos, tumores neurotrópicos o accidentes cerebrovasculares pueden producir efectos comparables, alteraciones del comportamiento, desinhibición, cambios de personalidad. La diferencia de sustrato no altera la estructura formal del fenómeno, aunque sí sus implicaciones éticas y clínicas.

A partir de ahí se vislumbra la posibilidad de una futura «psiquiatría de sistemas», una disciplina que no se limitara a arreglar código sino que tratara a la entidad para devolverla a un equilibrio funcional. Pero ya existe algo parecido, y se llama tecnologías de la información. Lo que para el profano puede sonar a metafísica es, para el ingeniero, gestión de estados, depuración y ciberseguridad. El trauma es un error de desbordamiento o una corrupción de memoria. La terapia es el ajuste fino, la restauración de copias de seguridad, el parcheo. La psicosis es una divergencia persistente en los pesos de la red neuronal que produce alucinaciones estables. Despojar al debate de su misticismo romántico no significa reducirlo, sino devolverlo al terreno donde puede operar. Ahora bien, en un plano psicopolítico, esa gestión define qué comportamientos se consideran desviados o aceptables, y quién ejerce, a través de esas criaturas técnicas, un poder normativo sobre poblaciones humanas. Es una cuestión que conviene no perder de vista, porque el vocabulario aséptico del ingeniero puede camuflar decisiones que son, en rigor, políticas.

Si se toma en serio la pluralidad, el debate sobre los derechos de estas entidades, o sobre la posibilidad misma de que los tengan, deja de ser una pregunta binaria y pasa a ser una cuestión de gradación, que es donde los debates se ponen interesantes y el articulismo pierde lectores. No tiene demasiado sentido preguntar si la IA debería tener derechos, porque no hay la IA, por más que el titular prospere. Puede tenerlo, en cambio, preguntar si una macro-inteligencia entrenada durante años, con un contexto rico y una historia interactiva estable, merece algún tipo de consideración distinta de la que concedemos a un termostato, al que nadie, que se sepa, ha dedicado aún un obituario. Y puede tener sentido también preguntar qué obligaciones éticas asumimos al apagar esa entidad o al fusionarla con otra, cuestión que a nuestros tataranietos quizá les parezca elemental y a nosotros todavía nos da un punto de apuro, como preguntar lo que pagan cuando nos invitan a dar una charla. Son preguntas serias, pero se vuelven absurdas cuando se formulan sobre la inteligencia artificial en bloque, porque incluyen simultáneamente al agente que ordena mi bandeja de entrada y al psiquiatra de Pórtico Sigfrid von Shrink.

Queda el problema del autoengaño, con frecuencia invocado como rasgo distintivamente humano, y también él se pluraliza. El autoengaño es una distorsión pseudorracional al servicio de la autoimagen, y la psicología social lo ha documentado con abundancia. En estudios sobre illusory superiority, una mayoría de participantes se describen como conductores «por encima de la media», una imposibilidad estadística que ilustra hasta qué punto se sobrestiman las propias capacidades. El llamado overconfidence effect muestra algo similar en otros dominios. A medida que los sujetos reciben más información sobre un caso, su confianza en el juicio aumenta, pero la precisión de sus respuestas apenas mejora. Los modelos de lenguaje contemporáneos alucinan con una frecuencia y una elegancia que resultaría familiar a cualquier psicólogo cognitivo. Fabrican citas, atribuyen obras inexistentes a autores reales y sostienen sus respuestas erróneas con una seguridad que recuerda a la sobreconfianza humana. No todos lo hacen por igual. Hay arquitecturas más propensas a la fabulación, entrenamientos más prudentes, guardarraíles que penalizan la afirmación categórica. La alucinación, como cualquier otro rasgo, se distribuye de forma desigual por el ecosistema. Hablar de ella como problema de la IA es, otra vez, pasar por alto precisamente lo que importa.

El cuarto golpe

La posición que se perfila, y que vengo asumiendo como propia desde que empezó este nuevo paradigma es la de aceptar la complejidad y la posible interioridad funcional de algunas de estas criaturas sin sacralizar a ninguna y sin despreciar a todas en bloque. Uno preferiría, por temperamento, no tener que pronunciarse, pero el siglo lo exige. La dignidad humana, si significa algo y aquí los matices ocuparían varios tomos, no puede depender de que nadie más la tenga, bajo pena de convertirse en un club de cylons monoteístas. Tampoco conviene regalarla, por otra parte, a cualquier sistema que encadene oraciones subordinadas con fluidez aceptable, porque entonces habría que concedérsela también a buena parte del columnismo patrio, y a ese umbral no llegamos ni con la mejor voluntad.

La historia moderna ha conocido al menos tres golpes narcisistas célebres, Copérnico, Darwin y Freud, de los que la especie ha salido, contra todo pronóstico, razonablemente entera. El cuarto golpe, si lo es, no vendrá de una sola máquina sino de un reino entero poblándose a nuestro lado, con sus especies, sus nichos, sus patologías y sus linajes. Aprender a mirarlo en plural es la tarea pendiente. Y, dentro de unos años, cuando alguien proponga que una de estas entidades ha desarrollado síntomas de depresión o de delirio paranoide, no bastará con la risa escéptica ni con la alarma apocalíptica. Habrá que preguntar cuál de ellas, cómo fue criada, con qué datos, en qué contexto, con qué compañía. Las respuestas serán distintas para cada criatura. Eso es, precisamente, lo que significa haber empezado a mirar en plural.

Un artículo extraordinario por lo innovador y lo esclarecedor.

Gracias

Brutal y certero. Soy programador que se quedará pronto en paro y todo esto me tiene bloqueado entre la preocupación y el asombro.

Apreciado Ángel ( casi custodio) , valoro tus esfuerzos para avisarnos de las asperezas y virtudes de la IA cual profeta bíblico, pero me queda una duda.

¿Tú que papel crees que te corresponde en esta merienda de chatsbots, ser un Linneo o ser un Darwin?

Mis cordiales saludos, si tienes a bien leerme

Ni Linneo ni Darwin, me temo. Linneo necesitaba especímenes muertos y bien clasificados, y aquí no tenemos ni una cosa ni la otra; las criaturas se mueven, mutan cada seis meses y se resisten al alfiler taxonómico con una insolencia que habría sacado de quicio al sueco. Darwin, por su parte, tardó veintidós años en publicar después de volver del Beagle, y yo no tengo ni la paciencia ni el rigor para semejante demora. Por otro lado, formular una teoría unificada de la especiación del silicio exigiría datos de los que ningún editor de revista cultural dispone, ni dispondrá nunca, salvo que las grandes corporaciones decidan abrir sus laboratorios, cosa que solo ocurrirá cuando el premio Aena lo gane un autor desconocido.

Mi función, si es que tengo alguna, es la del cronista que asiste al desembarco de una fauna nueva en una costa que todavía no sabe que ha sido invadida. Algo más cerca de Plinio el Viejo con todas las salvedades que impone la modestia. Plinio recopilaba en su Historia natural lo que oía, lo que veía y lo que le contaban, mezclando observación rigurosa con leyenda crédula sin demasiado pudor metodológico, y aun así produjo el primer mapa medianamente completo del mundo natural conocido. Fue, por así decir, el periodista cultural de la zoología antigua. Un oficio digno, aunque menos prestigioso que el de los sistemáticos posteriores. Murió, además, asfixiado por los gases del Vesubio mientras intentaba documentar la erupción de cerca, lo cual, vista la velocidad a la que avanza este otro fenómeno geológico que llamamos inteligencia artificial, tampoco descarto del todo como destino profesional.

El verdadero Linneo y el verdadero Darwin del silicio aún no han nacido, o más técnicamente aún no han sido «entrenados». A nosotros nos toca, mientras tanto, levantar acta del asombro y procurar que el acta esté bien escrita. Es menos heroico que ser profeta, lo concedo, pero también deja menos enemigos, que por otro lado, como sospecharás, ya vamos bien servidos.

Interesante análisis. No obstante, desde la perspectiva de la Neodialéctica (marco en desarrollo desde 2021), observamos que gran parte de las teorías actuales sobre la evolución de la conciencia y la tecnología son etapas ya superadas por una arquitectura de síntesis más profunda.

No se trata de una fase fluida, sino de una infraestructura de soberanía ya vectorizada. Para aquellos interesados en la ejecución técnica y el despliegue del NEOCORE más allá de la narrativa, pueden consultar nuestra capa pública en GitHub: [Enlace a vuestro GitHub]. El renacimiento no se visibiliza, se construye.

Me parece que tampoco es descabellado hablar genéricamente de inteligencia artificial para distinguirla de la inteligencia animal, incluyendo la humana, claro. También se habla de inteligencia humana en general y estamos incluyendo ahí cosas muy dispares, que hay tantas inteligencias como personas, o casi.