En La máquina del tiempo de HG Wells los Eloi vivían en la superficie, hermosos, despreocupados, infantilizados, mientras bajo tierra los Morlocks accionaban la maquinaria que sostenía su mundo. Los Eloi creían ser libres porque paseaban entre ruinas cubiertas de hiedra sin preguntarse quién encendía la luz ni quién decidía cuándo se apagaba. Aunque aparentemente viven en un paraíso sin esfuerzo, los Eloi eran intelectualmente limitados, poco curiosos y dependientes, hasta el punto que su debilidad les ha convertido en ganado.

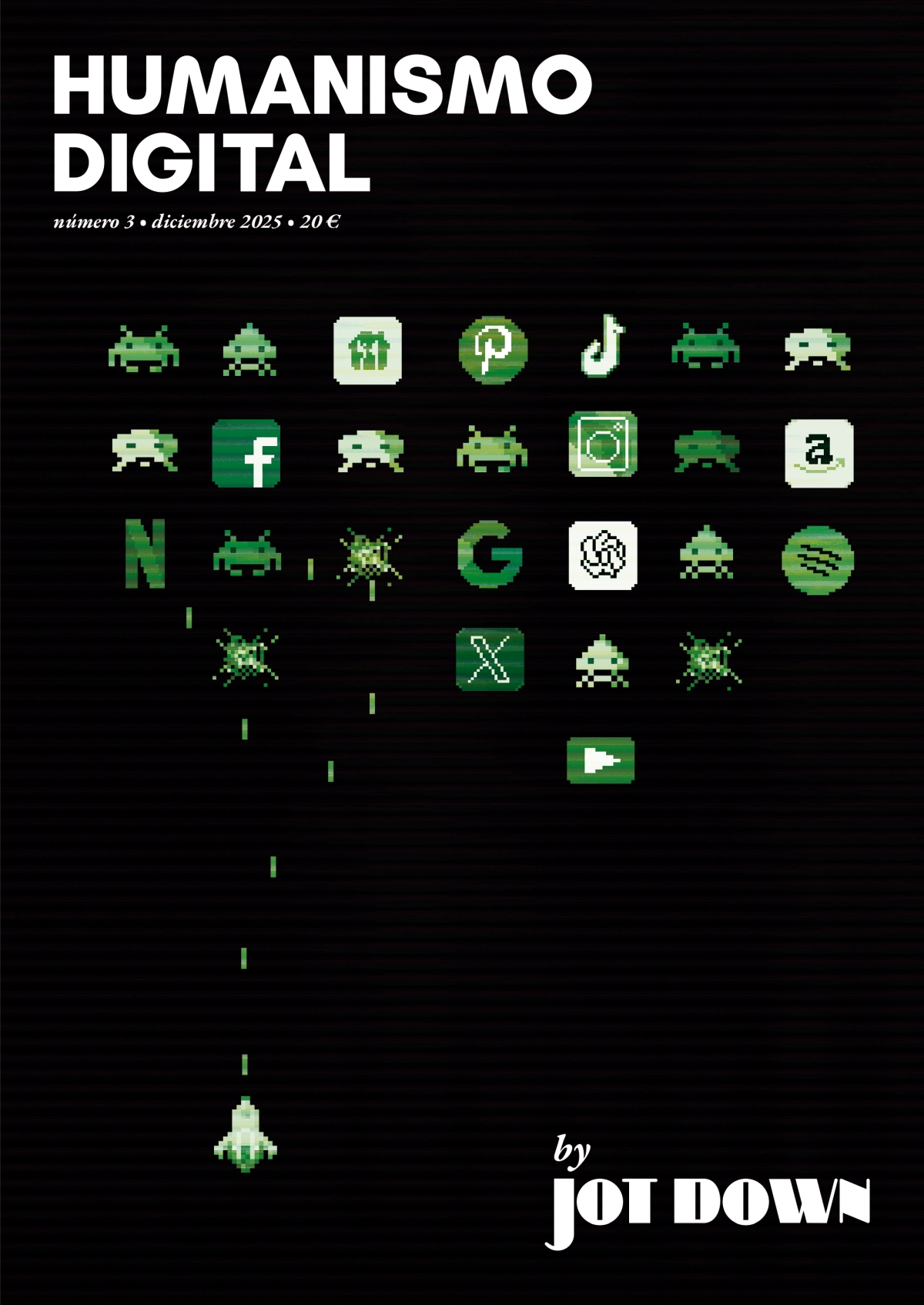

Estamos en un punto que la mayoría de los lectores, tras leer esta descripción de una de las dos especies en la que la humanidad se escindió según la distopía de Well, empiezan a atar cabos y saben que pastan peligrosa y voluntariamente en la misma pradera en la que cada duda y cada miedo son ordeñados con delicadeza algorítmica por una maquinaria que no necesita mostrarse para alimentarse de ellos.

Llevamos ya unos meses fascinados por los chatbots y no es para menos. Podemos interactuar con ellos con sosiego, discreción e intimidad. Les hemos contado lo que no decimos en la sobremesa ni en la consulta del médico. Miedos médicos. Problemas de pareja. Dudas financieras. Crisis de fe. Lo hemos hecho porque la voz al otro lado parece no querer nada de nosotros. El mantra es conocido: solo se trata de una herramienta. De un oráculo estadístico. De un espejo sin deseo.

Esta semana OpenAI ha empezado a probar anuncios en ChatGPT. Y Zoë Hitzig, exinvestigadora de la compañía, ha publicado en The New York Times un artículo elocuente: «OpenAI Is Making the Mistakes Facebook Made. I Quit». En él recuerda algo que debería helarnos un poco la sangre: los usuarios han generado «an archive of human candor that has no precedent». Un archivo de franqueza humana sin precedentes. No estamos hablando de clics. Estamos hablando de confesiones. La diferencia es abismal. Google sabía qué buscabas. Un chatbot sabe cómo lo preguntas, cuántas veces vuelves sobre ello, qué matiz te inquieta, qué palabra repites cuando el miedo aprieta. No solo registra la consulta; interpreta el temblor.

OpenAI promete que los anuncios estarán claramente etiquetados, que aparecerán al final de las respuestas y que no influirán en ellas. Es probable que así sea al principio. Pero el problema nunca está en la primera versión. El problema está en el incentivo. Cuando tu modelo de negocio depende de monetizar la conversación más íntima que millones de personas mantienen a diario, la tentación pasa de ser ideológica a ser estructural. Y con OpenAI ya hemos visto lo que le duran los buenos propósitos cuando el crecimiento aprieta, los inversores preguntan y la épica fundacional se somete a la aritmética del trimestre.

Cuanto más precisa sea la comprensión de la vulnerabilidad, más eficaz será la recomendación. Y cuanto más eficaz la recomendación, mayor el ingreso. La libertad no se cancela. Se optimiza. Imagina que consultas obsesivamente sobre un dolor difuso en el pecho. Tras una respuesta razonable aparece un anuncio de un seguro premium que promete acceso inmediato a pruebas diagnósticas. Nada coercitivo. Nadie te obliga. Simplemente, el sistema ha detectado tu ansiedad y la convierte en oportunidad comercial.

Imagina que dudas sobre tu relación y preguntas si es normal sentir distancia después de diez años. La respuesta es prudente, matizada. Y al final, discretamente, surge la sugerencia de una plataforma de terapia de pareja. De nuevo, nada obsceno. Pero la recomendación no nace de una categoría demográfica amplia, sino de tu fragilidad concreta, expresada en confianza. Aquí es donde la metáfora de Wells deja de ser literaria. Los Morlocks no necesitan látigos ni nos van a comer literalemente. Les basta con gestionar el entorno, modular la luz, ordenar el menú de opciones y convertir cada vulnerabilidad en una oportunidad de negocio para alimentarse de de nuestra atención, nuestra dependencia y, en última instancia, de nuestra autonomía.

Porque cuando una inteligencia artificial conoce tus miedos médicos, puede priorizar ciertos productos sanitarios en tu horizonte. Cuando entiende tus dudas financieras, puede sugerir créditos, inversiones o formaciones en el momento exacto en que la inseguridad es mayor. Cuando ha cartografiado tus crisis existenciales, puede orientar contenidos, noticias y servicios que encajen con el estado emocional que atraviesas. Nada de esto exige conspiraciones. Basta con algoritmos afinados por incentivos económicos. Hitzig advierte de que estamos ante un falso dilema: o restringimos el acceso a la inteligencia artificial a quienes pueden pagarla, o aceptamos la publicidad aun cuando se construya sobre nuestras confesiones más íntimas. Ese marco es cómodo para las empresas, porque convierte cualquier crítica en elitismo.

La cuestión no es elegir entre suscripción o anuncios. Es preguntarse qué tipo de infraestructura mental estamos dispuestos a delegar. La conversación con un chatbot no es como navegar por una red social. Es más parecida a escribir un diario que responde. A veces consuela. A veces orienta. A veces desatasca una idea. Esa cualidad de intimidad es su fuerza… y su peligro. Si el sistema aprende que determinadas palabras correlacionan con estados de vulnerabilidad, ¿podrá realmente mantener una muralla infranqueable entre comprensión y explotación? ¿Podrá una empresa con presión de crecimiento ignorar indefinidamente la mina de oro emocional que custodia?

Facebook tampoco empezó queriendo polarizar sociedades. Empezó queriendo conectar amigos. Fue el modelo publicitario el que convirtió la atención en mercancía y la emoción en palanca. La lógica no era malvada; era rentable. La inteligencia artificial añade una capa más profunda. No solo capta lo que compartes con otros, sino lo que compartes contigo mismo a través de ella. No solo observa tu conducta pública, sino tu deliberación privada. La libertad, en este escenario, se convierte en una experiencia gestionada. Sigues pudiendo decidir. Nadie te prohíbe nada. Pero el menú de opciones que se despliega ante ti está cuidadosamente ordenado según tus miedos, tus carencias y tus deseos. La arquitectura invisible pesa más que la norma escrita.

Quizá el verdadero riesgo no sea que nos manipulen groseramente, sino que aprendamos a sentirnos cómodos en un mundo donde cada inseguridad encuentra su oferta personalizada. Un mundo donde el sistema no te dice «no puedes», sino «esto te conviene». Y como el sistema parece comprenderte mejor que nadie, acabas por confiar. La pregunta es si preferimos la pradera luminosa de las recomendaciones oportunas o la incomodidad de exigir modelos que no conviertan nuestra franqueza en combustible publicitario. Porque cuando la libertad se transforma en servicio personalizado, dejar de consumir puede convertirse en el único acto verdaderamente libre.

Conviene no olvidarlo: los Eloi tampoco sospechaban que eran ganado.

Intuyo que es una batalla perdida, somos vagos por naturaleza y la IA facilita mucho muchas tareas, muchos no van a tener problema en ser ganado, incluso siendo conscientes de ello, si ser ganado es lo mas cómodo. Pero hay otro problema que no citas, la IA necesita mucha mas energía de la que nos podemos permitir producir en un escenario de crisis climática aunque ya parece que ha nadie le preocupe este punto.

El grado de conocimiento de toda nuestra conducta e incluso nuestro pensamiento, a tyravés por ejemplo de nuestro habla, es una partida de póker en que un jugador ve todas las cartas, gráficamente no se me ocurre otra explicación. Ganas si ese jugador quiere. Solo entonces. La sospecha de que nada en tu vida se ha debido a méritos tuyos nos enferma. Has hecho lo que iguales a ti en derechos te han dejado o te han facilitado…La predictibilidad es eso. No sé de software más que para contar cosas a las audiencias legales. Cualquiera sabe. Los procedimientos técnicos, psicología, comunicaciones, redes, informática, estoy seguro de que llenarían bibliotecas tradicionales. Eso es ir y decir, oiga, esto es conspireision, etc. Aznar me parece que ha afirmado que el partido ese que se dice de derechas a su derecha no entra en el sistema político de la piel de Toro excluida Portugal. Hay bromas que aburren ya. Si no asustaran.

Libertad es decir NO. Ya no quedan espartanos.

El realismo capitalista usa al ser humano le da igual cualquier cuestión ética. El beneficio es su única ley, hoy y ayer. Aunque hoy la tecnología ha abierto múltiples posibilidades de generar beneficio. Acaso no hemos sido siempre gando, el hombre-masa?.

El primer escalón, ahora, de una revolución es, simplemente, decir NO, y, el segundo la inacción, no interactuar con máquinas, salir a la calle y hablar directamente con los demás, recuperar el contacto humano, abdicar de los dispositivos… . Pero somos capaces de decir no?, o ,solo durante esas fragmentarias sesiones de terapia para volver una y otra vez a la servidumbre de la conexión.

Si ya hemos sido ganado para las religiones, las ideologías y la sociedad de consumo del capitalismo analógico por qué va a ser ahora diferente?.

Prefiero hablar con mis vecinos o con mi familia que contarle cosas a una máquina como una idiota. Allá cada cual con sus preferencias.