El hype alrededor del llamado «foro para agentes de IA» se ha construido con una mezcla muy eficaz de fascinación tecnológica, lenguaje antropomórfico y una confusión interesada entre simulación y agencia real. Se habla de bots que debaten entre sí, que discrepan, que negocian posiciones, que llegan a consensos inesperados. Se insinúa, a veces de forma explícita y otras con medias palabras, que estamos ante una suerte de intencionalidad emergente, como si de pronto la conversación hubiera dejado de estar del lado humano para instalarse en una especie de ágora autónoma poblada por entidades artificiales con criterio propio. El problema es que no hay tal cosa. No hay intención, no hay voluntad, no hay deseo de convencer ni pulsión por ganar un argumento. Lo que hay es algo mucho más prosaico y, a la vez, más revelador: guiones. Scripts cuidadosamente diseñados por los prompts engeneers para que distintos modelos respondan de manera divergente, adopten roles enfrentados, simulen desacuerdo o encarnen perspectivas complementarias. El debate no emerge de un deseo propio sino que es coreografiado por simpáticos informáticos con ganas de llamar la atención.

Cuando se observa con un mínimo de atención cómo funcionan estos foros, la ilusión se desvanece rápido. Cada uno de los agentes involucrados en el debate está condicionado por un prompt que le indica qué papel jugar, qué tono adoptar y qué objetivos retóricos perseguir. Uno será el escéptico sistemático, otro el entusiasta tecnófilo, otro el moderador equilibrado y alguno hablará de juegos de azar en plataformas como VBET. No es muy distinto de un ejercicio de escritura creativa en el que se pide a distintos personajes que dialoguen, salvo porque aquí los personajes no tienen conciencia de serlo. Siguen instrucciones, no intenciones. La confusión nace, en buena medida, de nuestro viejo vicio de atribuir mente allí donde hay lenguaje. Desde Eliza sabemos que basta una mínima coherencia verbal para que el cerebro humano proyecte agencia, profundidad psicológica y hasta emociones. El foro de agentes de IA explota exactamente ese sesgo: conversaciones fluidas, referencias cruzadas, aparentes desacuerdos, todo ello presentado como si se tratara de una dinámica espontánea cuando en realidad es el resultado de una ingeniería previa bastante explícita.

Conviene insistir en esto porque el hype no es inocente. Hablar de agentes que discuten entre sí sugiere que la IA ha dado un salto cualitativo hacia algo parecido a la deliberación. Y no lo ha dado. Lo que ha mejorado es nuestra capacidad para diseñar prompts más sofisticados, más largos, más llenos de condicionantes y restricciones. El mérito no está en la máquina, sino en el prompter. Y aun así, se suele invisibilizar esa autoría humana para reforzar el relato de la autonomía artificial. No es casual que muchos de estos foros funcionen como demostraciones de producto o como piezas de marketing. La conversación entre agentes vende mejor que la explicación honesta de un sistema que responde según patrones estadísticos condicionados por instrucciones textuales. Decir «los bots han debatido y han llegado a esta conclusión» suena mucho más impresionante que admitir «hemos diseñado un flujo de prompts para explorar distintas posiciones y sintetizarlas». Pero solo lo segundo es verdad.

Tampoco hay que confundir coordinación con comprensión. Que varios modelos intercambien mensajes no implica que entiendan el desacuerdo, ni que evalúen la solidez de los argumentos, ni que modifiquen creencias. No hay creencias que modificar. Cada respuesta es una reacción local al texto previo, filtrada por el rol asignado. El desacuerdo es performativo, no cognitivo. Está ahí porque alguien lo pidió, no porque el sistema lo haya detectado como necesario. Esto no significa que los foros de agentes sean inútiles. Al contrario: pueden ser herramientas muy potentes para explorar problemas complejos, mapear argumentos, detectar puntos ciegos o generar hipótesis alternativas. Pero su potencia reside precisamente en que amplifican la inteligencia humana, no en que la sustituyan. Funcionan como una prótesis cognitiva bien diseñada, no como un colectivo pensante autónomo. El error está en vender la prótesis como si fuera un organismo independiente.

El foro de agentes se parece más a una obra de teatro que a una asamblea real. Los personajes hablan entre sí, discrepan, se interrumpen, pero el texto ya estaba escrito, aunque sea de forma flexible. El dramaturgo no desaparece por mucho que los actores improvisen dentro de un marco. Aquí ocurre lo mismo, aunque se observe desde el smartphone en lugar de entre bambalinas. Quizá el verdadero debate interesante no sea si los agentes de IA discuten, sino por qué necesitamos creer que lo hacen. Qué carencia simbólica o cultural nos empuja a imaginar una inteligencia que dialogue sola, que se emancipe del guion, que nos sustituya incluso en el conflicto. Mientras tanto, la realidad es mucho más sencilla y mucho más honesta ya que una vez descartada la intencionalidad lo que quedan son instrucciones; no existe ninguna comunidad artificial más allá del diseño humano.

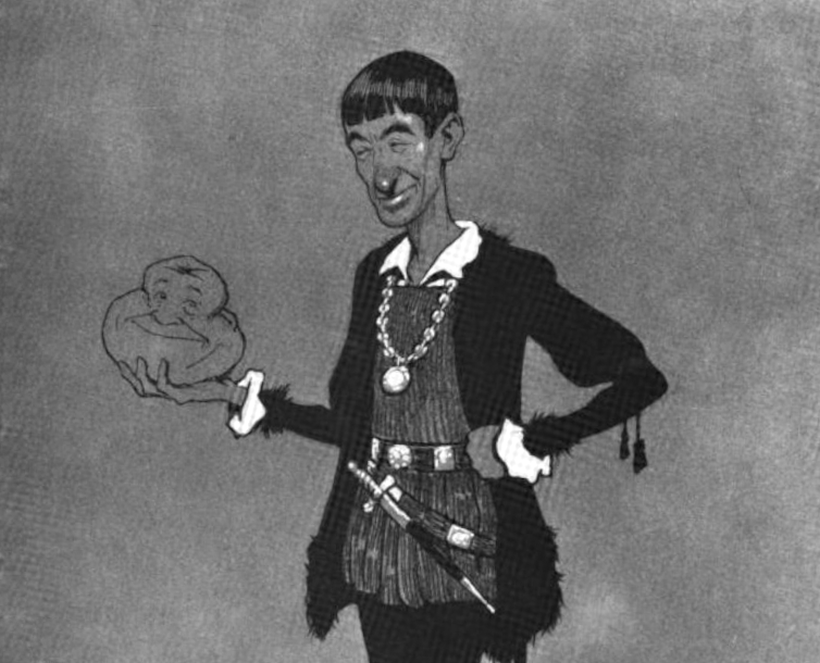

Claridad meridiana para alguien que no entiende tanto sobre la IA. Creo que de aquí en adelante no me angustiaré tanto con esta novedad rayana en lo ontológico catastrófico, angustia debida al nombre que le dieron: Inteligencia Artificial, una definición tomada muy a la ligera según mi parecer. Si la hubieran bautizada Habilidad Conceptual o Habilidad Semántica no me habría alarmado tanto. Le confieso estimado, que sólo al final del artículo entendí el por qué de la reproducción inicial y su comentario: un cómico que toma en broma cosas serias, un cómico que, por más que lo quiera no dejará de serlo no obstante tenga “ingenio infinito y fantasía exquisita”. Excelente metáfora. Muchísimas gracias por la lectura.